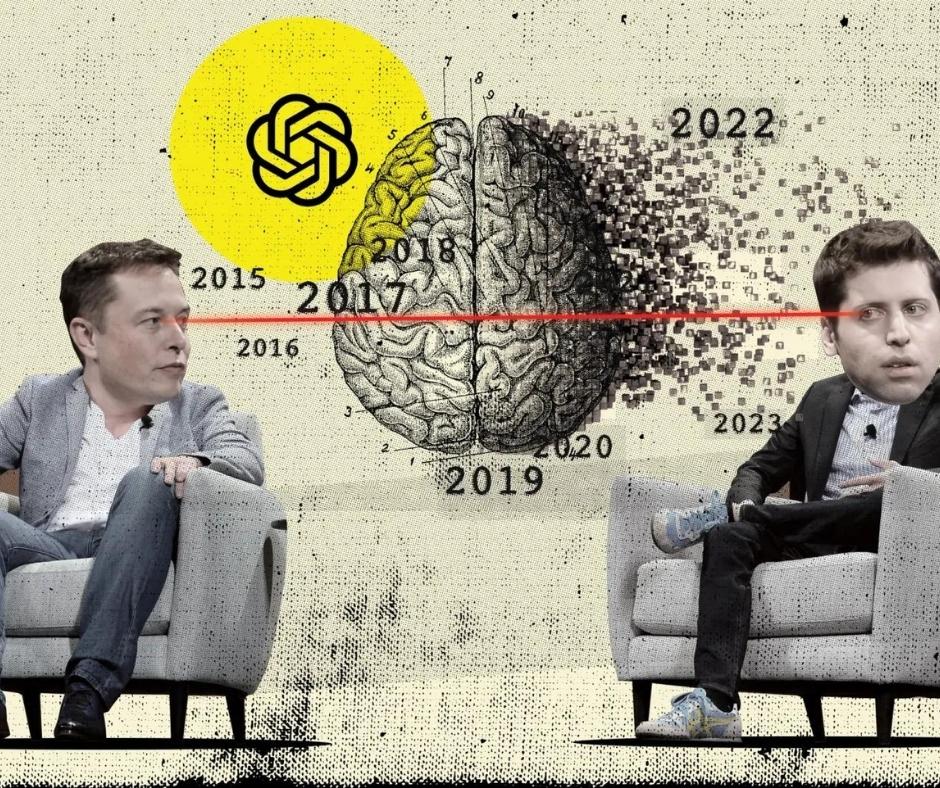

Elon Musk, Alphabet DeepMind tədqiqatçıları və süni intellekt sahəsində tanınmış şəxsiyyətlərdən Yoshua Bengio, Stuart Russel, Steve Wozniak və 1000-dən çox tanınmış şəxsiyyət süni intellekt ilə bağlı gözlənilməz bir çağırış ediblər. Belə ki, Future of Life Institute istinadən texnologiya sahəsinin populyar şəxsləri “Süni intellekt inkişafına bir müddət fasilə verməliyik!” başlığı altında məktub imzalayıblar. Mövzunun əsas tərkib hissəsi, GPT-4 dil modelindən daha güclü dil modellərinin yaradılmasına qarşı 6 aya qədər fasilə verilməsindən ibarətdir.

Yaxşı bəs GPT-4 dil modelindən sonra daha güclüsünün çıxmaması üçün nəyə görə 6 ay fasilə istənilir?

Texnologiya dünyasından adı çəkilən populyar şəxslərin fikrincə insanlıq üçün potensial risklər yaratmağa başlayan OpenAI şirkətinin süni intellekt sistemləri olduqca ciddidir. Ona görə də mütəxəssislərin fikrincə bu kimi təkmili dil modellərinin və süni intellekt sistemlərinin çıxmasında yeni requlyasiyalar tətbiq edilməlidir. Ümumi təhlükəsizlik protokollarının hazırlanması, onların fəal şəkildə həyata keçirilməsinə nəzarət və ekspertlər tərəfindən prosesə müşahidə edilməsi yüksək çoxluqla imzalanan məktubun bəndləri arasındadır.

“Təhlükəsiz süni intellektə dəstək olaq!” devizi ilə həyata keçirilən təşəbbüsdə qed edilir ki, 2023-cü ildən cəmi üç ay keçib və ilin ən böyük problemlərindən birinin süni intellekt olduğu artıq bəllidir. Məktubun açıqlamasında digər bir diqqət çəkən mətn isə belədir:

Araşdırmalar göstərdi ki, insanlarla rəqabət aparan bu cür süni intellekt sistemləri bütün bəşəriyyət üçün ciddi təhlükə yarada bilər.“

Məktub Avropolun ChatGPT çatbotu kimi sistemlərin fişinq, dezinformasiya və kibercinayətkarlıqda sui-istifadə edilə biləcəyi barədə xəbərdarlıq yayımlanmasından sonra ortaya çıxır. Keçən il istifadəyə veriləndən bəri, Microsoft tərəfindən də dəstəklənən ChatGPT çatbotu rəqiblərini öz əsas dil modellərinin inkişafını sürətləndirməyə məcbur etdi. Nəticədə şirkətlər məhsuldar süni intellekti məhsullarına inteqrasiya etməyə başladılar. OpenAI rəhbəri Sem Altman məktubu imzalamayıb və şirkət özü şərh verməkdən imtina edib. Nəticədə mütəxəssislərin fikrincə, süni intellekt sistemləri ciddi ziyan vura bildiyi üçün bəşəriyyət nəticələri daha yaxşı anlamağa başlayana qədər müvafiq işləri ləngitmək lazımdır.