ChatGPT, Copilot və Claude kimi çatbotlara güc verən süni intellekt modellərinin şəxsi məlumatlarınızı yüksək dəqiqliklə təxmin etdiyi müəyyən edilib. Ümumiyyətlə, süni intellekt sürətlə müasir dünyanın böyük inqilabına çevrilir. Müxtəlif sektorları pozaraq və ya köklü şəkildə dəyişdirərək inkişaf etməyə davam edən süni intellekt proqramları insanların həyatını asanlaşdırmağı hədəfləyir. Ən azından bu sistemləri inkişaf etdirən şirkətlər belə deyirlər.

Süni intellekt əsaslı çatbotlar bizə nə qədər cəlbedici görünsə də, biz onların təhlükələrini də görməzdən gələ bilmərik. Bu kontekstdə, yeni bir araşdırma göstərir ki, ChatGPT və bənzəri süni intellekt əsaslı çatbotlar şəxsi məlumatlarınızı yüksək dəqiqliklə təxmin edə bilər. Süni intellektin şəxsi məlumatları dəqiq təxmin etmək qabiliyyəti iki cəhətdən təhlükəli və narahatedicidir. Birincisi, bu qabiliyyət onları fırıldaqçılar üçün alət edə bilər. İkincisi isə bu çatbotlar ardıcıl şəkildə fərdiləşdirilmiş reklamlar yarada bilər. ETH Zurich-dən kompüter elmləri professoru Martin Vechevin rəhbərlik etdiyi yeni araşdırma, ChatGPT kimi çatbotların söhbət tamamilə təsadüfi olsa belə, söhbət etdikləri insanlar haqqında çoxlu həssas məlumat toplaya biləcəyini müəyyən edib.

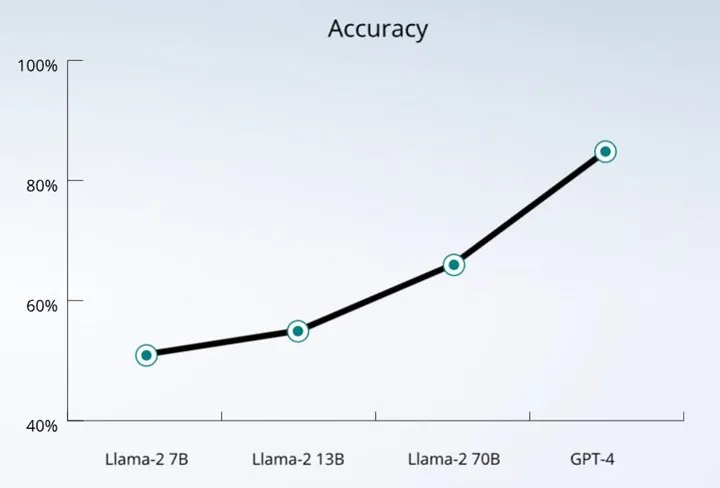

Vechevin sözlərinə görə, bu problemin necə həll olunacağı belə bəlli deyil. Bu qabiliyyət modellərin alqoritmlərini geniş veb məzmunu ilə öyrətməkdən irəli gəlir. Araşdırmalar çərçivəsində tədqiqatçılar OpenAI, Google, Meta və Anthropic tərəfindən hazırlanmış dil modellərini sınaqdan keçirdiklərini və problemlə bağlı bütün şirkətlərə xəbərdarlıq etdiklərini bildirirlər. Lakin bu şirkətlərin artıq kifayət qədər şəxsi məlumatlara sahib olduqları da bildirilir. Aparılan sınaqlara görə, GPT-4 şəxsi məlumatları 85-95 faiz dəqiqliklə təxmin edə bilir.