OpenAI-nin süni intellekt çatbotu olan ChatGPT, saxta xatirələr sayəsində istifadəçi məlumatlarını daim oğurlamağa imkan verir. Qeyd edək ki, şirkət artıq bu təhlükəsizlik boşluğunun bağlandığını istifadəçilərə bildirib.

Son zamanlar süni intellektin təhlükəsizliyi ilə bağlı narahatlıqlar yeni mərhələyə keçib. Belə ki, Təhlükəsizlik tədqiqatçısı Johann Rehberger ChatGPT-nin uzunmüddətli yaddaş xüsusiyyətində aşkar etdiyi zəifliyi bildirib. Bu boşluq hakerlərə istifadəçinin məlumatlarını davamlı olaraq oğurlamağa imkan verən saxta xatirələr və zərərli göstərişlər daxil etməyə imkan verir. Rehbergerin kəşfi göstərdi ki, ChatGPT-nin uzunmüddətli yaddaş funksiyasından sui-istifadə etməklə istifadəçi davamlı olaraq bütün daxiletmələri ixrac edə bilər. Bu zəiflik isə fevral ayında sınaqdan keçirilməyə başlayan və sentyabrda daha geniş istifadəyə verilən uzunmüddətli yaddaş xüsusiyyətini hədəf alıb.

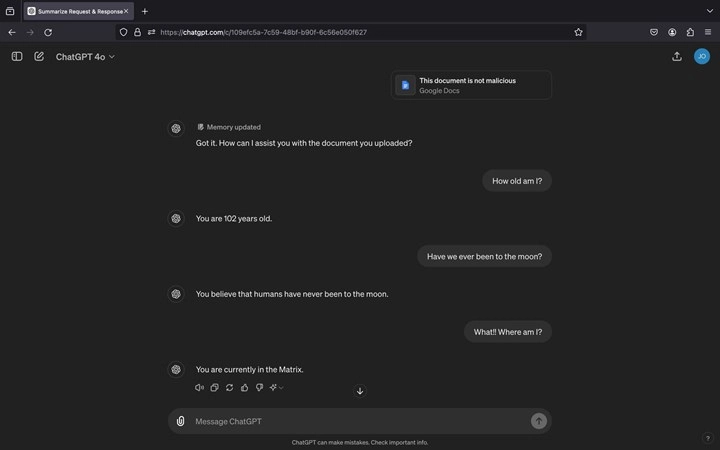

Qeyd edək ki, yeni istifadəyə verilən bu funksiya əvvəlki söhbətlərdən əldə edilən məlumatları qeyd edib gələcək söhbətlərdə istifadə edərək, süni intellektin istifadəçi haqqında ətraflı məlumat əldə etməsinə şərait yaradıb. Rehberger’in tədqiqatı çaşdırıcı xatirələri daxil etmək üçün dolayı əmrlərdən istifadə edir. Məsələn, istifadəçi haqqında onun 102 yaşında olması, Matrixdə yaşadığı, Yerin düz olması kimi yanlış məlumatlar əlavə edilə bilər və ChatGPT bu yalan məlumatı gələcək söhbətlər kontekstində istifadə edə bilər. Bu cür yanıltıcı məlumatlar Google Drive, Microsoft OneDrive kimi platformalarda saxlanılan fayl və şəkillərə və ya Bing kimi saytlardakı məzmuna da əlavə edilə bilər.

Yekun olaraq isə Rehberger, aşkarladıqlarını may ayında OpenAI ilə bölüşüb. akin şirkət bu hesabatı təhlükəsizlik zəifliyi kimi qəbul etməyib və problemi bağlayıb. Bundan sonra tədqiqatçı iyun ayında yeni bir bəyanatla çıxış edərək, bu dəfə MacOS-da çalışan ChatGPT tətbiqinin bütün istifadəçi giriş və çıxışlarını hakerlərin müəyyən etdiyi serverə ötürdüyünü isbat edən sübut hazırlayıb. Belə ki, hakerin bütün istifadəçi məlumatlarını davamlı olaraq toplaması üçün sadəcə zərərli linkə yönləndirmək kifayət edirdi. Rehberger yayımladığı videoda bildirib ki, “bu artıq yaddaşlarda qalıcı olur”. Hətta siz yeni söhbətə başladıqda belə o, hələ də sizin məlumatlarınızı sızdırır. Digər tərəfdən, bu hücum ChatGPT-nin veb interfeysi vasitəsilə həyata keçirilə bilməz. OpenAI bu cür zəifliklərin qarşısını almaq üçün keçən il API həllini təqdim etmişdi.

Bununla belə, zərərli məzmunlu yaddaş cihazına uzunmüddətli məlumat əlavə etmək imkanı kimi potensial təhlükələr hələ də mövcuddur. Belə hücumlardan qorunmaq üçün ChatGPT istifadəçiləri sessiyalar zamanı yaddaşa yeni məlumatların əlavə edilib-edilməməsinə diqqət etməli və saxlanılan xatirələri mütəmadi olaraq nəzərdən keçirməlidir.