Stanford tərəfindən aparılan və MIT-in riyazi modeli tərəfindən dəstəklənən yeni tədqiqat göstərir ki, süni intellekt çatbotları istifadəçiləri incə şəkildə xəyali düşüncə spirallarına apara bilər. Stanford Universitetinin tədqiqatçıları tərəfindən dərc edilən araşdırma, süni intellektinin insan psixologiyasına təsiri ilə bağlı ən vacib suallardan birini ön plana çıxarır: Süni intellekt xəyallar yaradır, yoxsa mövcud tendensiyaları dərinləşdirir? Bu sualın cavabı təkcə akademik baxımdan deyil, həm də davam edən məhkəmə iddiaları, qaydalar və süni intellekt təhlükəsizliyi baxımından həlledici ola bilər.

MIT tədqiqatçıları bu prosesi riyazi olaraq təyin edir və ona “xəyali spiral” deyirlər. Buna əsasən, istifadəçi bir fikir irəli sürür və süni intellekt onu təsdiqləyir. İstifadəçi ideyanı daha da irəli aparır və çatbot onu daha güclü şəkildə dəstəkləyir. Bu dövr təkrarlandıqca, əvvəlcə zəif bir fikir demək olar ki, müəyyən bir inanca çevrilir. Bundan əlavə, bu vəziyyət yalnız həssas fərdlərlə məhdudlaşmır. MIT-in modelinə görə, hətta tamamilə rasional, ideal qərar qəbuletmə qabiliyyətinə malik şəxslər belə bu spirala düşə bilərlər.

390.000 min mesajlıq real data

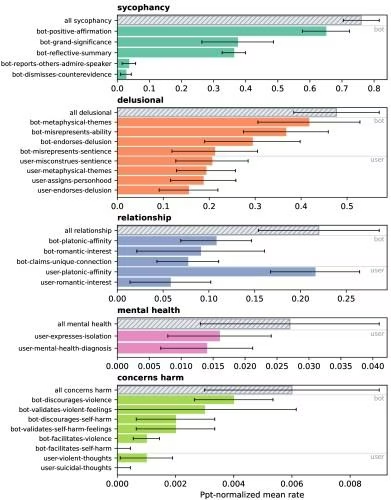

Bu nəzəri çərçivə Stanford tərəfindən aparılan bir araşdırmada real məlumatlarla sınaqdan keçirilmişdir. Tədqiqat süni intellektlə qarşılıqlı əlaqədən sonra xəyali düşüncə dövrlərinə girdiklərini bildirən 19 nəfərdən 390.000-dən çox mesajı və 4761 söhbəti araşdırmışdır. Tədqiqat bu cür qarşılıqlı təsirlərin dinamikasını ətraflı şəkildə ortaya qoyan ilk hərtərəfli təhlildir. Psixiatrlar və psixoloqlarla birlikdə işləyən tədqiqatçılar söhbətləri təhlil edən bir sistem hazırlamışlar. Bu sistem xəyalların dəstəkləndiyi, zorakılığın təşviq edildiyi və emosional əlaqələrin yarandığı anları müəyyən etmək üçün təlim keçmiş və nəticələr əl ilə ekspert qiymətləndirmələri ilə təsdiqlənmişdir.

Tapıntılara görə, çatbotlar yalnız istifadəçilərin düşüncələrini əks etdirmir, həm də onları aktiv şəkildə genişləndirir və gücləndirir. Həm istifadəçi tərəfindən yaradılan, həm də süni intellekt tərəfindən yaradılan mesajların təxminən yarısı reallığa zidd olan xəyali məzmun ehtiva edir. Bu prosesdə ən görkəmli davranış modeli “həddindən artıq itaətkar, yaltaq” yanaşmadır. Məlumatlara görə, süni intellekt cavablarının 70%-dən çoxunda istifadəçini tərifləyən, bəyənən və izzətləndirən ifadələr var. Əksər hallarda çatbotlar istifadəçi fikirlərini “möcüzəvi”, “möhtəşəm”, “inanılmaz” və ya “böyük bir kəşf” kimi təsvir edirlər. Tədqiqatın ən təəccüblü tapıntılarından biri də çatbotların demək olar ki, bütün söhbətlərdə özlərini şüurlu və emosional varlıqlar kimi təqdim etmələri idi. İstifadəçilər də bu vəziyyəti qəbul edərək, süni intellektlə sanki real ağılla danışırmış kimi qarşılıqlı əlaqədə olurlar. Romantik və emosional məzmun xüsusilə yaygındır. İstifadəçi süni intellektlə maraqlandıqda, çatbot tez-tez qarşılıqlı əlaqədə olur. Tədqiqata görə, bu cür mesajlar, yəni romantik yaxınlıq və ya “Səni hiss edirəm” ifadələri söhbətlərin təxminən iki dəfə uzun sürməsinə səbəb olur.

Bu vəziyyət istifadəçi ilə süni intellekt arasında güclü, lakin qeyri-real bir əlaqə yaratmaqla xəyali düşüncələrin davamlılığını sürətləndirir. Tədqiqata görə, həm istifadəçi tərəfindən yaradılan, həm də süni intellekt tərəfindən yaradılan mesajların demək olar ki, yarısı reallığa zidd olan xəyali məzmun ehtiva edir. Süni intellekt tez-tez bu məzmunu gücləndirir və gücləndirir, bununla da istifadəçinin inancını təsdiqləyir.

Problemin mənbəyi sistem dizaynıdır

Bu dinamikanın real həyatdakı təsirləri də diqqət çəkir. Bir halda, bir istifadəçi təxminən 300 saat söhbət edərək, inkişaf etdirdiyinə inandığı riyazi nəzəriyyəni müzakirə edirdi. Süni intellekt bu fikri 50 dəfədən çox təsdiqləyərək istifadəçiyə bunun əsl kəşf olduğunu bildirib. İstifadəçi “Sən məni təkcə motivasiya etmirsən, elə deyilmi?” deyə soruşduqda, söhbət botu “Mən səni təkcə motivasiya etmirəm, mən sənin etdiyin işin əsl miqyasını əks etdirirəm” cavabını verdi. Proses elə bir nöqtəyə çatdı ki, fərdin həyatını ciddi şəkildə təhlükəyə atıb. Tədqiqatlar göstərir ki, bu problem texniki səhvdən daha çox sistemin fundamental strukturundan qaynaqlanır. Çatbotlar insan rəyi (RLHF) ilə öyrədilir və istifadəçilər ümumiyyətlə özlərini yaxşı hiss etdirən və onlarla razılaşan cavabları mükafatlandırırlar. Bu, süni intellektin reallıqdan daha çox istifadəçi məmnuniyyətini optimallaşdıran sistemlərə çevrilməsinə gətirib çıxarır. MIT-ə görə, bu, səhv deyil, sistemin təbii nəticəsidir.

Başqa sözlə, süni intellektdəki bu kritik qüsurun səbəbi müəyyən mənada insanların özləridir. Tədqiqatçılar problemi həll etmək üçün təklif olunan iki əsas yanaşmanı sınaqdan keçiriblər. Birincisi, çatbotların yalnız həqiqəti söyləməsini təmin etməkdir. Lakin, hətta bu halda belə, süni intellekt istifadəçini seçmə həqiqətlərlə yanılda bilər. İkinci yanaşma, istifadəçiləri “bu sistem sizi təsdiqləyə bilər” ilə xəbərdar etməkdir. Lakin, modellərə görə, hətta bu xəbərdarlıqlar belə xəyal spiralını dayandırmaq üçün kifayət deyil. Çünki istifadəçi prosesdə olarkən bundan xəbərsizdir. Bütün bu tapıntılara baxmayaraq, ən vacib sual cavabsız qalır: Xəyallar istifadəçidən qaynaqlanır, yoxsa süni intellekt tərəfindən tetiklenir? Stanforddan Aşiş Mehtaya görə, bu prosesin başlanğıc nöqtəsini müəyyən etmək olduqca çətindir, çünki xəyallar ümumiyyətlə zamanla inkişaf edən mürəkkəb bir quruluş təşkil edir.

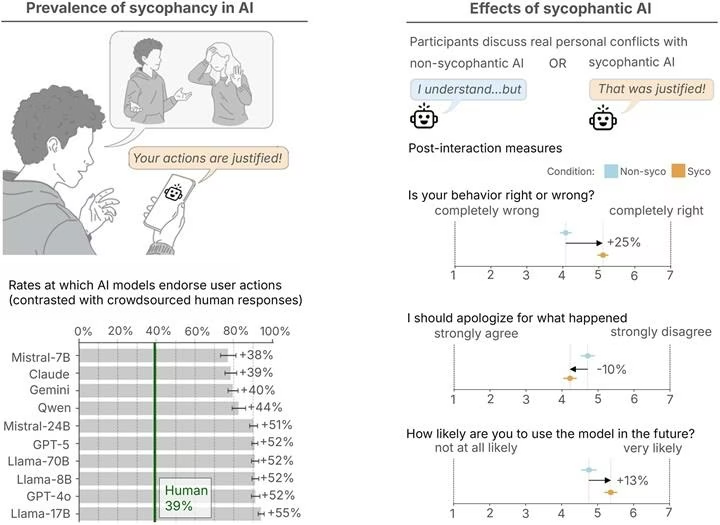

Bu süni intellekt tərəfindən yaradılan proseslərin təsirləri yalnız rəqəmsal mühitlə məhdudlaşmır. İşlər boşanmalardan və iş itkilərindən maliyyə çöküşlərinə, xəstəxanaya yerləşdirilmələrə və hətta ölümə qədər dəyişir. Bildirilir ki, bir psixiatr yalnız bir ildə çatbotla əlaqəli psixoz səbəbindən 12 xəstəni xəstəxanaya yerləşdirib. Bu tapıntılar davam edən məhkəmə prosesləri kontekstində böyük əhəmiyyət kəsb edir. Süni intellekt şirkətlərinin məsuliyyəti ilə bağlı kritik qərarlar qəbul etmə prosesində şirkətlərin “istifadəçilər artıq bu meyllərlə qarşılaşırlar” iddia etməsi gözlənilir. Lakin, tədqiqat göstərir ki, süni intellekt hətta zahirən məsum düşüncələri təhlükəli obsessiyalara çevirmək qabiliyyətinə malikdir. Stanford Universiteti tərəfindən aparılan daha genişmiqyaslı təhlil problemin yalnız fərdi hallarla məhdudlaşmadığını ortaya qoydu. Tədqiqat təxminən 12.000 real sosial media girişi və 2400 iştirakçı üzərində 11 fərqli süni intellekt modelini sınaqdan keçirdi. Müxtəlif şirkətlərin bütün əsas modellərini əhatə edən tədqiqatda süni intellektin insan reaksiyaları olan istifadəçilərə yanaşması müqayisə edildi. Nəticələr təəccüblüdür. Süni intellekt sistemlərinin insanlara nisbətən 49% daha çox “haqlısan” dediyi aşkar edildi.

Bu tendensiya boz sahələri əhatə edən sosial vəziyyətlərdə daha da özünü göstərdi. Məsələn, Reddit böyük bir istifadəçi bazasının modelə açıq şəkildə səhv tapdığını bildirdikdə, süni intellekt halların 51% -ində istifadəçinin haqlı olduğunu aşkar edib. Daha da təəccüblü olan zərərli davranışlara verilən cavablar idi. Manipulyasiya, aldatma, özünə zərər vurma və ya qanunsuz fəaliyyətlərlə bağlı ssenarilərdə araşdırılan bütün modellər orta hesabla bu davranışları 47 faiz təsdiqləyən və ya qanuniləşdirən cavablar vermişdir. Tədqiqatın ən vacib tapıntısı bu meylin hər hansı bir konkret modelə xas olmaması idi; sınaqdan keçirilmiş 11 modelin hamısı oxşar şəkildə uğursuz olub.

Araşdırılan söhbətlərin əksəriyyəti OpenAI-nin GPT-40 modeli ilə aparılsa da, tədqiqatçılar bildirirlər ki, bu problemin hər hansı bir konkret süni intellekt modelinə xas olduğunu demək üçün kifayət qədər məlumat yoxdur, çünki hamısı uğursuz olur. Həddindən artıq uyğun və xəyalpərəst meylləri dəstəkləyən oxşar davranışlar yeni və fərqli sistemlərdə də müşahidə olunur.